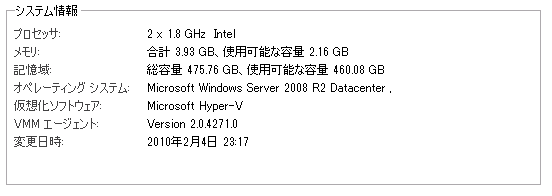

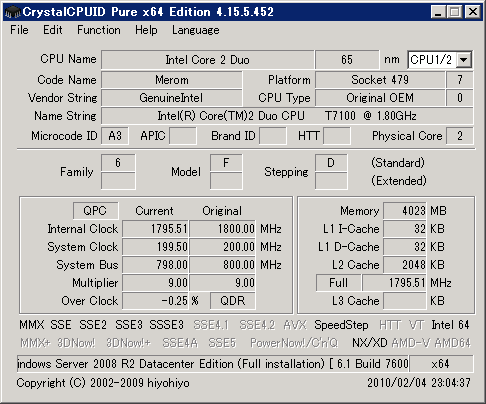

自宅の検証環境にはインストールマニアックス 3 の勉強用で構築した Hyper-V Server 2008 R2 が 1 台あります。

# 私は VPS コースだったのですが勉強を兼ねて構築していました。

せっかくなので、この環境で Live Migration 環境を作ってみたいと思います。

1 台なので Live Migration のテストはできませんが。

# 2 月のどこかで中古の ThinkPad を購入して Live Migration の検証環境を作りたいな~とは思っているのですが。

??? UPS の電源容量が小さいので Live Migration 環境を ML115 で作ろうとすると UPS がなり始めてしまうのですよね・・・。

ちなみにこの環境はドメインに参加済みの環境です。

■クラスタのインストール

まずはクラスタ環境を構築する必要があります。

Hyper-V Server 2008 R2 では [sconfig.cmd] で表示されるメニューからクラスタの有効化ができます。

- [11] を選択

?

- [はい] をクリックします。

- DISM で機能が有効化されます。

- [OK] をクリックします。

?

■iSCSI イニシエーターサービスの自動起動化

デフォルトでは iSCSI イニシエーターのサービスは自動起動になっていませんので、自動起動に設定し初回の起動を行います。

# ローカルで MMC が使えないのでコマンドで。

- コマンドプロンプトで以下のコマンドを実行し、サービスを自動起動にします。

| sc config MSiSCSI start= auto |

-

自動にしてもサーバーが再起動しないとサービスが起動されないので、再起動しない場合は以下のコマンドで起動させます。

?

■iSCSI ターゲットへの接続

iSCSI ターゲットへの接続ですが、iSCSI イニシエータのコマンドとして [iscsicli.exe] が用意されています。

Server Core 環境なのでコマンドで設定するしかないのかと思っていたのですが、GUI である、[iscsicpl.exe] が使えるんですね。

これは楽でいいです。

ターゲットを入力してクイック接続してみます。

# ターゲット側で、iSCSI ターゲットを作成し、Hyper-V Server 2008 R2 の iSCSI イニシエータの FQN を追加済みです。

接続できました。

ターゲット側でディスクを割り当てておきましたので、まずはクォーラム用のディスクが使用可能な状態です。

ひとまず、[DISKPART] コマンドで Q ドライブに割り当てておきます。

今回は、ディスク 2 に新規のディスクが割り当てられていますので以下のコマンドを実行していきます。

diskpart

list disk

select disk 2

create part primary

format quick

assign letter=Q

exit |

?

■クラスタの構築

[cluster.exe] を使ってクラスタを構築してもいいのですが今回は勉強を兼ねて PowerShell で。

ドメインにクラスタ用のコンピュータアカウントを作成して無効状態にし、セキュリティとして今回の作業に

使用するドメインユーザーのフルコントロールを付与している状態です。

??

??

後は以下のコマンドを順次実行していきます。

クラスタのコンピュータアカウントにフルコントロールを指定したユーザーをローカルの Administrators に入れるところから

コマンドを記載しています。

現在のサーバーは DHCP で IP を割り当てているので、クラスタの作成時に静的 IP を指定していません。

net localgroup “Administrators” “<ドメイン名"ユーザー名>” /add

runas /user:“<ドメイン名ユーザー名>”? cmd

powershell

Import-Module FailoverClusters

New-Cluster ?Name “HVS-CLUSTER” ?Node $ENV:COMPUTERNAME

これでクラスタの構築は完了です。

他の端末に、RSAT の [フェールオーバー クラスタリング ツール] を導入して接続してみたいと思います。

?

?

正常に接続できました。

クラスターの作成自体も管理ツールからリモートで実施できるので、管理端末が用意できるのであれば、Hyper-V Server 上で

PowerShell を使わなくても構築することが可能です。

■クォーラムディスクの設定

作成直後のクォーラムはノードマジョリティになっているので、Q ドライブに割り当てているディスクをクォーラムとして

追加したいと思います。

Get-ClusterQuorum

Get-ClusterAvailableDisk | Add-ClusterDisk

Get-ClusterResource | ft -Wrap

Set-ClusterQuorum -NodeAndDiskMajority "クラスター ディスク 1" |

?

これでクォーラムがノードおよびディスクマジョリティになりました。

| Get-ClusterQuorum

Cluster??????????????????? QuorumResource??????????????????????????? QuorumType

——-??????????????????? ————–??????????????????????????? ———-

HVS-CLUSTER??????????????? クラスター ディスク 1??????????? NodeAndDiskMajority

|

?

■CSV の有効化

初期状態では CSV は無効になっているので、これを有効化します。

| Get-Cluster | %{$_.EnableSharedVolumes="Enabled/NoticeRead"} |

EnabledSharedVolumes は [Enabled/NoticeRead] を指定する必要があります。

CSV を有効にするときには以下の通知が表示されます。

[Enabled] だけですと上記の通知がコンソール内に表示されるだけで有効にすることができません。

有効にするためには通知を読んだ事を指定する必要がありますので、[Enabled/NoticeRead] が必要となります。

無効にする場合は、[Disabled] を指定します。

GUI から CSV の無効化はできないみたいなので、CSV を無効にする場合には PowerShell から実行する必要があるようですね。

■CSV にディスクを追加

現在はクォーラム用のディスクしか iSCSI に作っていなかったので CSV 用のディスクを新規に作り、CSV に割り当てたいと思います。

私の環境の iSCSI ターゲットは Storage Server 2008 ですので、仮想ディスクを追加して、iSCSI イニシエータでマッピングします。

あとはこのディスクも DiskPart でフォーマットしておきます。

今回はドライブ文字は不要ですのでアサインはしません。

# クォーラムも不要なのですが、今までのクラスタ構築の癖で Q ドライブを割り当てちゃうんですよね。

diskpart

list disk

select disk 3

create part primary

format quick

exit |

?

後はこのディスクを CSV に追加します。

Get-ClusterAvailableDisk | Add-ClusterDisk

Get-ClusterResource | ft -Wrap

Add-ClusterSharedVolume "クラスター ディスク 2" |

?

これで CSV の追加は完了です。

CSV に追加されているディスクを確認してみます。

| Get-ClusterSharedVolume

Name?????????????????????? State????????????????????? Node

—-?????????????????????? —–????????????????????? —-

クラスター ディスク 2????? Online???????????????????? hvs2008r2 |

?

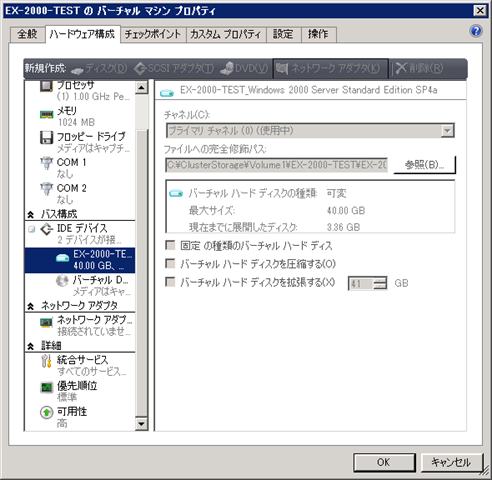

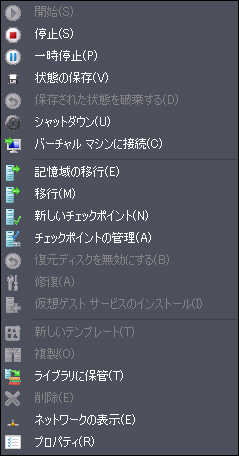

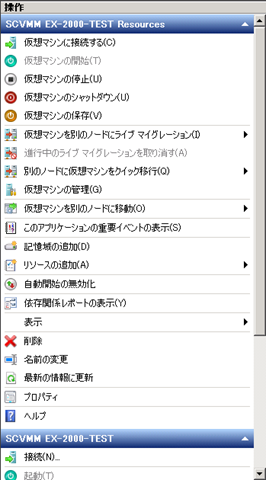

■仮想マシンの作成

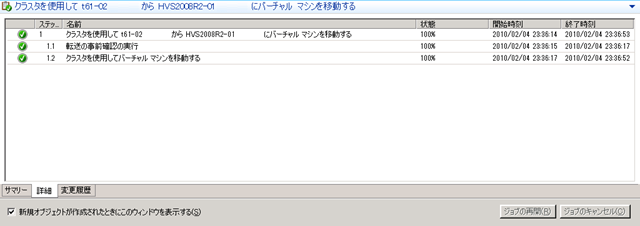

残るは Live Migration する仮想マシンの作成です。

ひとまず管理用端末の GUI で仮想マシンを作りたいと思います。

クラスタの管理は RSAT の [フェールオーバー クラスタリング ツール] をインストールすればよいのですが、仮想マシンの作成は

クラスタ用の管理ツールではできません。

仮想マシンを作成する場合は [Hyper-V ツール] をインストールする必要があります。

今回は管理用端末に SCVMM 2008 R2 の端末を使用しているのですが、この場合でも RSAT の Hyper-V ツールが必要になるんですね。

GUI を使用して CSV を使用する仮想マシンを作成することができました。

?

?

PowerShell の場合は、[Add-ClusterVirtualMachineRole] を使用すればよいと思うのですが、私の環境では

エラーになってしまうんですよね・・・。

GUI からは作成できているのでコマンドのオプションを間違っているような気がするのですが原因までは追えていません。

?

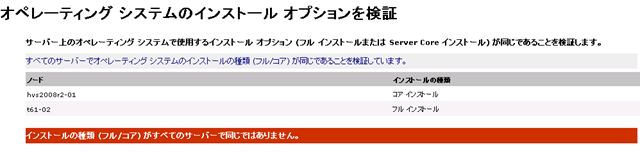

コマンドからの仮想マシンの作成がうまくいっていないのですがひとまずこれで Live Migration に必要となる環境までは

設定ができたと思います。

GUI って楽だな~と改めて実感しました・・・。

![]()